11 plaintes contre l’utilisation abusive des données personnelles par les IA de Meta

-

L’association autrichienne noyb a déposé 11 plaintes contre Meta auprès d’autant d’autorités chargées de la protection des données en Europe, dont la CNIL. Elle demande à la multinationale d’arrêter immédiatement l’utilisation abusive des données personnelles des utilisateurs de Facebook et Instagram pour l’entrainement de ses IA tel que le prévoit sa nouvelle « Politique de confidentialité ».

L’association de Max Schrems a annoncé avoir déposé 11 plaintes en Europe (en Autriche, Belgique, France, Allemagne, Grèce, Italie, Irlande, Pays-Bas, Norvège, Pologne et Espagne) contre la nouvelle politique de confidentialité de Facebook et Instagram mise en place par Meta, concernant l’utilisation de toutes les données des utilisateurs pour entrainer les IA de la multinationale.

Depuis fin mai, les utilisateurs européens de ces réseaux sociaux ont reçu un email dont le sujet est « nous mettons à jour notre Politique de confidentialité à mesure que nous développons l’IA de Meta ». Ce message indique qu’à partir du 26 juin 2024, l’entreprise s’appuiera désormais sur la base légale des « intérêts légitimes » de Meta pour utiliser les informations de ses utilisateurs « pour développer et améliorer l’IA de Meta ».

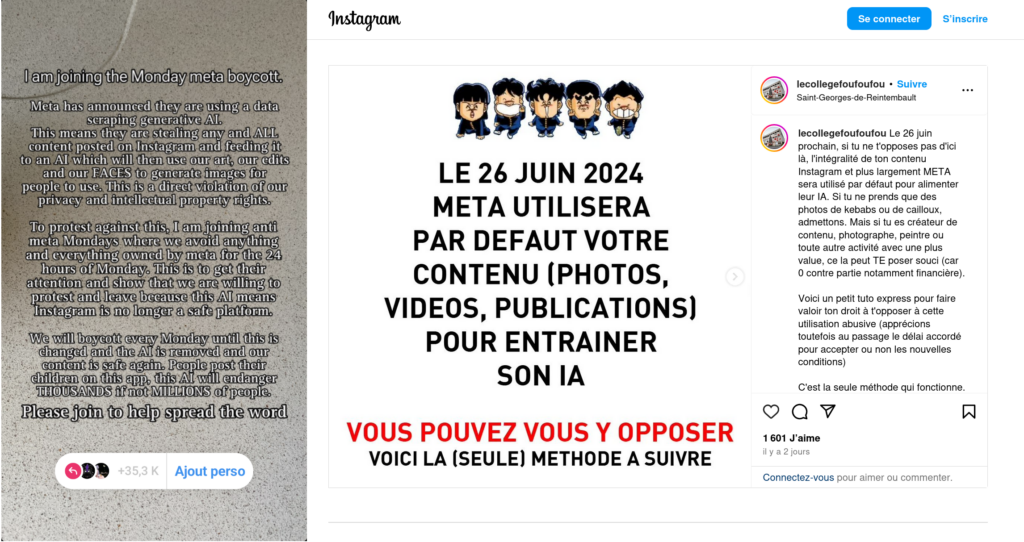

Cette décision de Meta a fait réagir certains utilisateurs de ses réseaux sociaux où on a pu voir des chaînes de protestation se mettre en place :

Un formulaire dissuasif

Plus clairement, l’entreprise s’autorise à partir de cette date à utiliser les données (contenus publiés mais aussi données personnelles) de ses utilisateurs collectées depuis la création de leurs comptes pour entrainer ses intelligences artificielles. Un seul moyen d’y échapper : cliquer sur le lien situé au milieu du message expliquant que « cela signifie que vous avez le droit de vous opposer à l’utilisation de vos informations à ces fins » et remplir le formulaire auquel il renvoie.

Et encore, Meta y demande d’ « expliquer l’incidence de ce traitement sur vous » et suggère donc qu’elle pourrait refuser d’accéder à la demande. « Alors qu’en théorie, l’opt-out pourrait être mis en œuvre de telle sorte qu’il ne nécessite qu’un seul clic (comme le bouton “se désinscrire” dans les newsletters), Meta rend extrêmement compliqué le fait de s’y opposer, même pour des raisons personnelles », s’indigne noyb dans son communiqué.

L’association estime aussi que « bien que le choix logique soit celui d’un consentement explicite (opt-in), Meta prétend à nouveau qu’elle a un “intérêt légitime” qui l’emporte sur les droits fondamentaux des utilisateurs ».

noyb rappelle que l’entreprise a déjà voulu s’appuyer sur son « intérêt légitime » pour utiliser les données personnelles de ses utilisateurs pour mettre en place son système de publicités ciblées, mais que la Cour de justice de l’Union européenne a rejeté l’utilisation de cette base légale.

Meta utilise aussi une phrase très vague et très générale pour signaler ce qu’elle s’autorise à faire : « l’IA chez Meta est notre collection de fonctionnalités et d’expériences d’IA générative, comme les outils de création IA et Meta AI, ainsi que les modèles qui les alimentent ». Telle que nous la comprenons, l’entreprise s’autorise à utiliser ces données pour entrainer toutes ses IA.

Dans ses plaintes, noyb accuse Meta d’avoir « pris toutes les mesures nécessaires pour dissuader les personnes concernées d’exercer leur droit de choisir », et de ne pas avoir donné les informations nécessaires à ses utilisateurs.

Aucun intérêt légitime

Elle y estime tout bonnement que Meta « n’a aucun “intérêt légitime” qui prévaut sur les intérêts » des plaignants qu’elle accompagne et « aucune autre base légale pour traiter des quantités aussi importantes de données à caractère personnel pour des finalités totalement indéterminées ».

Elle pointe le fait que l’entreprise « tente en réalité d’obtenir l’autorisation de traiter des données à caractère personnel pour des moyens techniques larges et non définis (“technologie d’intelligence artificielle”) sans jamais préciser la finalité du traitement en vertu de l’Article 5(1)(b) du RGPD ».

Données mises à la disposition de n’importe quel “tiers”

Elle ajoute que l’entreprise n’est même pas « en mesure de différencier correctement entre les personnes concernées pour lesquelles elle peut s’appuyer sur une base légale pour traiter les données à caractère personnel et les autres personnes concernées pour lesquelles une telle base légale n’existe pas ». De même, elle lui reproche de ne pas être capable de faire la différence « entre les données à caractère personnel qui relèvent de l’Article 9 du RGPD [qui pose une interdiction de principe des traitements relatifs à l’origine raciale ou ethnique, aux opinions politiques, convictions religieuses ou philosophiques ou à l’appartenance syndicale, ndlr] et les autres données qui n’en relèvent pas ».

Enfin, l’association pointe le fait que « Meta déclare elle-même que le traitement des données à caractère personnel est irréversible et qu’elle n’est pas en mesure de respecter le “droit à l’oubli” ».

Pour Max Schrems, « Meta dit en substance qu’elle peut utiliser “n’importe quelle donnée provenant de n’importe quelle source pour n’importe quel usage et la mettre à la disposition de n’importe qui dans le monde”, à condition que ce soit par le biais d’une “technologie d’intelligence artificielle”. Cela est clairement non conforme au RGPD. L’expression “technologie d’IA” est extrêmement large. Tout comme “l’utilisation de vos données dans des bases de données”, il n’y a pas de limite légale réelle ».

Il ajoute que « Meta précise également que les données des utilisateurs peuvent être mises à la disposition de n’importe quel “tiers”, c’est-à-dire n’importe qui dans le monde ».

Accord avec l’autorité irlandaise

Interrogée par le média irlandais The Journal, l’autorité de protection irlandaise DPC dont dépend Meta (son siège européen étant à Dublin) a expliqué que l’entreprise a retardé le lancement de cette nouvelle politique de confidentialité « à la suite d’un certain nombre de demandes de la DPC qui ont été traitées ».

L’autorité irlandaise indique que « Meta affiche maintenant une notification dans sa barre de navigation, a ajouté des mesures de transparence supplémentaires (des articles dans le "AI privacy center") et un mécanisme dédié d’opposition ». Enfin, l’autorité insiste sur le fait d’avoir obtenu que Meta attende quatre semaines entre la notification aux utilisateurs et la date du premier entrainement avec ces données.

Elle ajoute que Meta l’a assurée « que seules les données personnelles des utilisateurs basés dans l’UE (posts et non commentaires) partagées publiquement sur Instagram et Facebook au moment de l’entrainement seront utilisées et que cela n’inclura pas les données personnelles provenant de comptes appartenant à des utilisateurs de moins de 18 ans ».

Pour noyb, cela signifie que « cette violation flagrante du RGPD est (de nouveau) basée sur un “accord” avec la DPC. Celle-ci a déjà conclu un accord avec Meta qui a permis à l’entreprise de contourner le RGPD – et qui s’est soldé par une amende de 395 millions d’euros contre Meta après que le Conseil européen de la protection des données (EDPB) a annulé la décision de la DPC irlandaise ».

Interrogée par email par Next, Meta n’a pas encore répondu à nos questions.

Source : next.ink

-

Je salue toujours ces défenseurs de la confidentialité qui ont le courage de faire respecter le RGPD et notre vie privée. Néanmoins, malgré les scandales, je trouve que les gens restent désespérément naïfs, voire irresponsables, face à l’exploitation systématique de leurs données par les réseaux sociaux. Avec l’IA, l’aphorisme ‘quand c’est gratuit, c’est toi le produit’ a encore de beaux jours devant lui.

-

Quand je tente de convaincre foireusement ceux qui m’entourent, je dirais que c’est plus par dépit.

A force d’utiliser ces plateformes qui se sont offertes, c’est comme de changer d’armoire… Faut faire le tri, monter la nouvelle armoire et tout migrer.

Du coup, bah “z’ont qu’a m’espionner… Osef” -

Vite je ferme mon compte, ha ba non j’en ai pas

-

Abrutissons l’I.A. avec des données fantaisistes, c’est à notre portée! et ça pourrait même être drôle

Bonjour ! Vous semblez intéressé par cette conversation, mais vous n’avez pas encore de compte.

Marre de refaire défiler les mêmes messages ? Créez un compte pour retrouver votre position, recevoir des notifications des nouvelles réponses, sauvegarder vos favoris et voter pour les messages que vous appréciez.

Grâce à votre participation, ce message peut devenir encore meilleur 💗

S'inscrire Se connecter