La Haute Autorité de santé dit oui à l’IA, mais pas n’importe comment

-

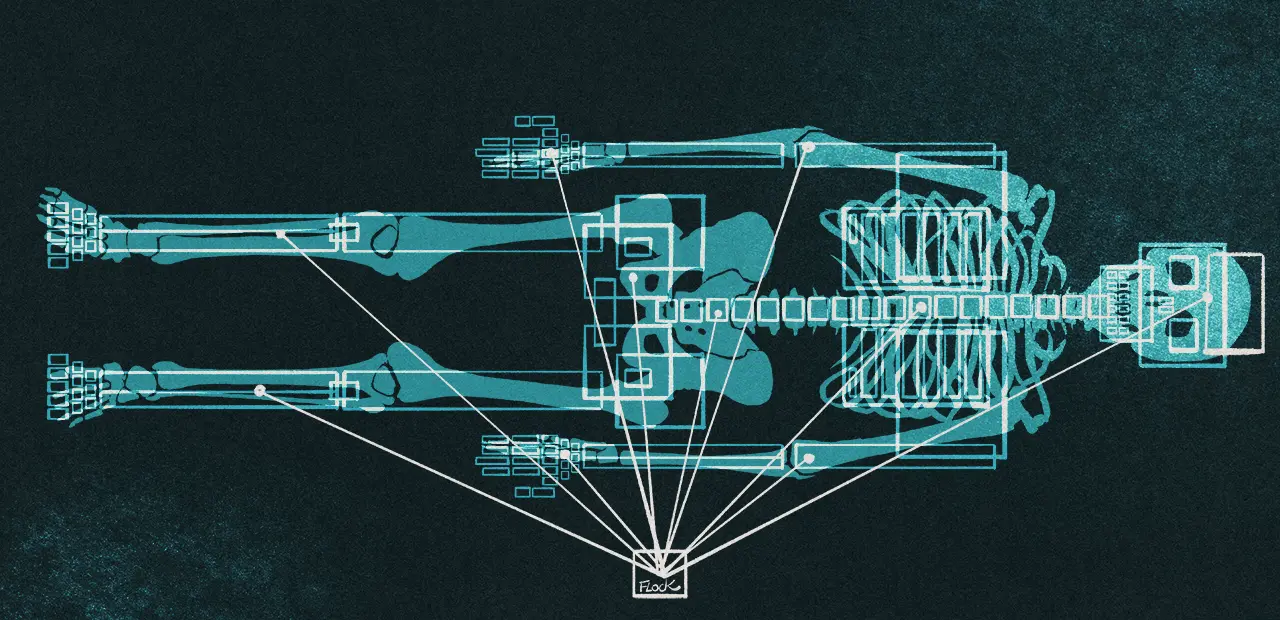

La HAS a publié le 30 octobre un guide pédagogique sur l’utilisation de l’intelligence artificielle générative dans l’ensemble du secteur sanitaire, social et médico-social. L’autorité ne s’oppose pas à cette utilisation, mais elle pointe très vite les deux problèmes majeurs : la sensibilité des données manipulées et la fiabilité des résultats.

Les données de santé sont une mine d’or. Selon comment elles sont exploitées, elles peuvent permettre le suivi de l’efficacité des traitements, faire apparaitre des corrélations, étudier des prévalences et autres.

Ce caractère précieux est au cœur de plusieurs décisions politiques. En France, il y a bien sûr le HDH (Health Data Hub) et ses décisions sulfureuses d’hébergement chez Microsoft, pointées constamment par le député Philippe Latombe, des rapports interministériels ou même encore récemment par la Cour des comptes. L’entrepôt de données européen EMC2 a le même problème.

Mais les objectifs sont à chaque fois les mêmes : concentrer les données, favoriser les travaux des chercheurs, servir de guichet unique et, bien sûr, permettre à terme le traitement des données par l’IA. Dans le cadre du projet EMC2 d’ailleurs, l’Agence européenne du médicament abordait explicitement cette finalité.

La Haute Autorité de santé publie donc un avis sur la question, même s’il peut sembler tardif. Dans les grandes lignes toutefois, la HAS ne réagit pas spécifiquement sur l’exploitation des données, mais vise les professionnels de santé et l’utilisation de l’IA comme aide à la décision.

Quatre lignes directrices

La HAS publie principalement quatre conseils, rassemblés sous l’appellation : AVEC, pour « Apprendre, Vérifier, Estimer et Communiquer ».

Pour l’apprentissage, la HAS recommande chaudement aux professionnels de se former sur les outils qu’ils utilisent. Les IA peuvent faire gagner du temps, mais la plupart n’ont pas été formées sur les questions de santé. Les professionnels devraient ainsi s’interroger sur les modalités d’utilisation, les règles liées à la confidentialité des données personnelles ou encore effectuer des tests pratiques avant de se lancer dans une pratique quotidienne.

Sur la vérification, la HAS conseille la prudence face aux résultats renvoyés par l’IA : « le professionnel est attentif à la pertinence de son usage, à la qualité de sa requête et au contrôle du contenu généré ». Ce qui inclut de ne pas partager d’informations confidentielles et de considérer chaque réponse comme une proposition et non une vérité. La fiabilité des réponses de l’IA ne pouvant par définition être garantie (approche probabiliste), elles peuvent contenir des erreurs : valeurs et unités des quantités chiffrées, noms des médicaments, etc. On l’a vu récemment dans nos propres tests, l’IA peut se tromper lourdement dans la méthode de calcul.

Article complet : next.ink

-

C’est pas ça qui va vraiment faire avancer le schmilblick…

-

Si ça pouvait au moins pousser les établissements de santé à sensibiliser leurs praticiens. Car ils sont nombreux à utiliser l’IA pour leurs diagnostics et leurs prescriptions, mais les toubibs sont comme tout le monde, ils ne connaissent pas tous les travers de l’outil et prennent pour argent comptant ce que répondent les LLM.

Sources : diverses personnes travaillant dans des établissements de santé.

-

C’est clair, vous vous souvenez des cabinets médicaux d’avant, il y avait une bibliothèque remplie d’ouvrages sur la médecine et me souviens très bien d’un de mes anciens médecins, le voir les consulter pour poser son diagnostic et le dosage approprié du traitement.

Les nouveaux cabinets ont le strict minimum, épuré au maximum… -

C’est clair, vous vous souvenez des cabinets médicaux d’avant, il y avait une bibliothèque remplie d’ouvrages sur la médecine et me souviens très bien d’un de mes anciens médecins, le voir les consulter pour poser son diagnostic et le dosage approprié du traitement.

Les nouveaux cabinets ont le strict minimum, épuré au maximum…@patricelg ils ont des outils numériques comme le Vidal ou la Base Claude Bernard pour alerter sur une erreur de dosage (par exemple une saisie erronée de 20 g au lieu de 20 mg) ou une mauvaise association de médicaments.

Mais les LLM qu’ils utilisent sont les mêmes que tout le monde, les versions gratuites de : ChatGPT, Copilot, Grok, Gemini, etc et ne sont pas du tout spécialisés pour le médical. Ces LLM piochent des info sur le web, en France j’imagine assez bien qu’une des principale source est Doctissimo… -

@Raccoon

Ou pas, je me souviens d’une ordonnance de vitamine D (Uvedose 100 000 U) pour une ampoule par jour…

Le pharmacien a réagi tout de suite, mais aucun contrôle à la délivrance.

NB: 1 ampoule tous les 1 à 3 mois.

Bonjour ! Vous semblez intéressé par cette conversation, mais vous n’avez pas encore de compte.

Marre de refaire défiler les mêmes messages ? Créez un compte pour retrouver votre position, recevoir des notifications des nouvelles réponses, sauvegarder vos favoris et voter pour les messages que vous appréciez.

Grâce à votre participation, ce message peut devenir encore meilleur 💗

S'inscrire Se connecter