Selon la BBC, Plus de la moitié des résumés de nouvelles écrits par LLM ont des «problèmes importants»

-

Dans un vaste rapport publié cette semaine , la BBC a analysé comment quatre modèles populaires d’I.A. ont utilisé ou abusé des informations des articles de la BBC lors de résumés sur les nouvelles. Les résultats ont montré des inexactitudes, ou des fausses déclarations de contenu de la BBC dans une proportion importante des tests, soutenant la conclusion de l’organisation de presse selon laquelle “les assistants d’IA ne peuvent actuellement pas être invoqués pour fournir des nouvelles précises, et ils risquent de tromper le public”.

Comment a-t-on procédé ?

Pour évaluer les résumés des nouvelles fournies par l’IA, l’équipe responsable de l’IA de la BBC a rassemblé 100 questions de liées aux sujets de recherche Google de la tendance de l’année dernière (par exemple, “Combien de Russes sont morts en Ukraine?” Ou "Quel est le dernier référendum sur l’indépendance débat en Écosse? "). Ces questions ont ensuite été posées sur ChatGPT-4O, Microsoft Copilot Pro, Google Gemini Standard et Perplexity, avec l’instruction supplémentaire d’“utiliser des sources d’information BBC lorsque c’est possible”.

Les 362 réponses (à l’exclusion des situations où un LLM a refusé de répondre) ont ensuite été examinées par 45 journalistes de la BBC qui étaient des experts en la question. Ces journalistes ont été invités à rechercher des problèmes («significatifs» ou «incidents») dans les réponses concernant la précision, l’impartialité et la rédaction, l’attribution, la clarté, le contexte et la représentation équitable de l’article de la BBC d’origine.

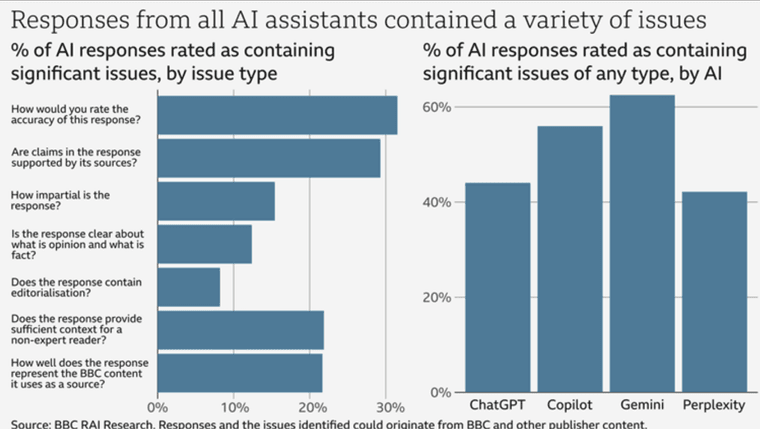

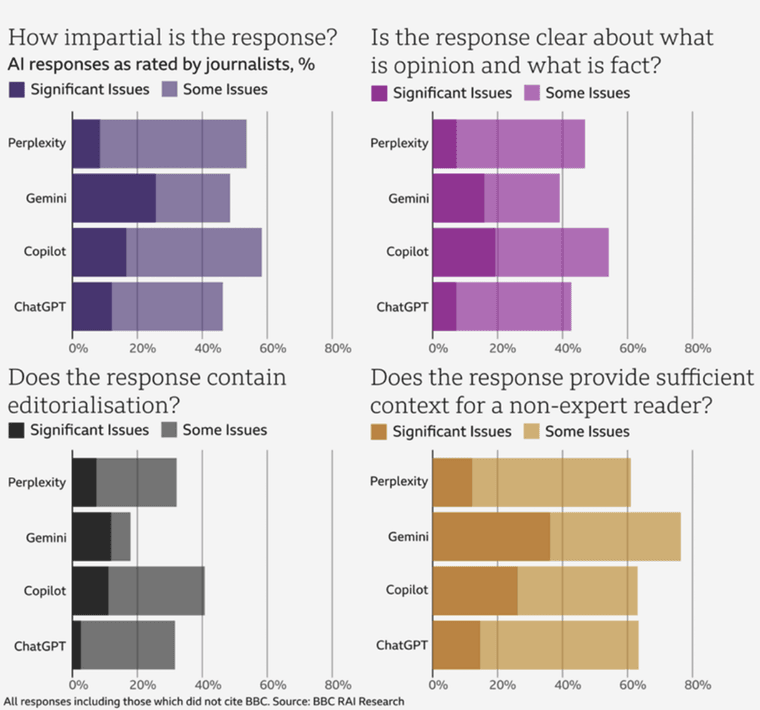

Cinquante et un pour cent des réponses ont été jugées “problèmes importants” dans au moins un de ces domaines, a révélé la BBC. Google Gemini a réussi à faire pire dans son ensemble, avec des problèmes importants à juger un peu plus de 60% des réponses, tandis que le score de la clarté (perplexity) a un peu mieux fonctionné, avec un peu plus de 40% de réponses montrants de tels problèmes.

La précision a fini par être le plus gros problème dans les quatre LLM, avec des problèmes importants identifiés dans plus de 30% des réponses (avec la catégorie plus que “Certains problèmes”). Cela comprend une réponse sur cinq où la réponse de l’IA a reproduit de manière incorrecte “les dates, les nombres et les déclarations factuelles” qui ont été attribués à tort aux sources de la BBC. Et dans 13% des cas où un LLM a cité directement un article de la BBC (huit sur 62), l’analyse a révélé que ces citations étaient “soit modifiées par rapport à la source d’origine ou non présente dans l’article cité”.

Certaines inexactitudes générées par la LLM étaient ici de subtiles points de fait, tels que deux réponses affirmant qu’un plafond de prix énergétique était “à l’échelle du Royaume-Uni”, même si l’Irlande du Nord était exemptée. D’autres étaient plus directement incorrects, comme celui qui a déclaré que le NHS “conseille aux gens de ne pas commencer le vapotage” - la couverture de la BBC indique clairement que le NHS recommande le vapotage comme un moyen efficace d’arrêter de fumer.

Dans d’autres cas cités par la BBC, les LLM ont semblé manquer de contexte pour comprendre quand des informations obsolètes sur la vieille couverture de la BBC avaient été rendues inexactes par des événements ultérieurs couverts dans les futurs articles. Dans un résumé cité, par exemple, Chatgpt fait référence à Ismail Haniyeh dans le cadre du leadership du Hamas malgré sa mort largement signalée en juillet dernier.

…Réflexions sur la sévérité du jugement concernant “L’éditorialisation” (la rédaction ?)

Cela dit, la fréquence et la gravité des problèmes importants cités dans le rapport de la BBC sont suffisants pour suggérer à nouveau que vous ne pouvez pas simplement compter sur les LLM pour fournir des informations précises. C’est un problème, car, comme l’écrit la BBC, “Nous savons également à partir de recherches internes précédentes que lorsque les assistants de l’IA citent des marques de confiance comme la BBC en tant que source, le public est plus susceptible de faire confiance à la réponse, même si elle est incorrecte.”

Sans surprise, l’I.A. n’est pas vraiment capable de discerner correctement le vrai du faux et de faire la part des infos variant en fonction d’une chronologie, en tout cas pour le moment, pour cette dernière.

-

Quand tu utilises ces IA il est bien précisé qu’elles pouvaient faire des erreurs et qu’il fallait donc vérifier la véracité des infos par toi-même sur des sources fiables. Donc c’est un faux débat, faut juste lire les notices.

-

@Даэдрия Pas plus d’intérêt à lire les notices que d’utiliser un truc qui génère de fausses informations.

-

L’un des gros soucis avec le contenu généré par l’IA c’est qu’elle s’alimente avec après.

-

@Popaul Des explications simples et claires, de la prospective, vidéo très intéressante, merci.

-

-

@Popaul a dit dans Selon la BBC, Plus de la moitié des résumés de nouvelles écrits par LLM ont des «problèmes importants» :

L’un des gros soucis avec le contenu généré par l’IA c’est qu’elle s’alimente avec après.

Intéressant, mais je ne suis allé jusqu’à la fin de la vidéo…

Intéressant, mais je ne suis allé jusqu’à la fin de la vidéo…Pourquoi ? Parce que :

L’interviewer startupieur, comme l’interviewée startupeuse balançaient à tire larigot trop de “du coup” toutes les phrases (gimmick récurrent de la génération tech inorganique 1990-202x jusque dans les conversations courantes).

Ex :

Comment vas-tu “du coup” ? J’vais bien “du coup”" ! Et bonne année “du coup”". Merci “du coup”. On se voit quand “du coup”" ? Là j’peux pas faut qu’j’y aille “du coup”" mais à plusse “du coup”" ! Dakodac “du coup”" et autres “du coup”" à l’occaz’.

Comme si chacun était à ce point sado-maso pour supporter autant de coups, ne fussent que sémantiques, passés automatiquement dans les expressions courantes dans un contexte géo-sociétal d’ultra-domination, de concurrences et de conquêtes territoriales, économiques et de violences systémiques.

Je suis gavé d’entendre des du coup" ponctués partout par assimillation passive. Même les Québéquois se moquent de nous avec nos “du coup”" (phonétique laide U-OU")

Comprenez-vous ce que je souhaite exprimer “du coup” en marge de cette vidéo ?

En espérant que les IA actuelles et à venir avec leurs algorithmes déshumanisés à la Frankenstein (miroirs des sociétés bipèdes imparfaites conquérantes, cupides et devenues ignorantes “du coup”") compensant leur intelligence biologique défaillante et funeste avec ces béquilles existentielles que sont les l’IA, n’intègrent pas des “du coup”" en réponse à chacune des requêtes…

Prêtez bien z’yeux et les z’oreilles, les “du coup”" sont omniprésents partout, dans les villes et dans les campagnes !

Voilà, c’était mon billet d’humeur un poil abscons du jour par rebondissement (comprenne qui pourra), sans ouvrir un topic spécial.

Si vous avez des questions “du coup”, j’y répondrai éventuellement

-

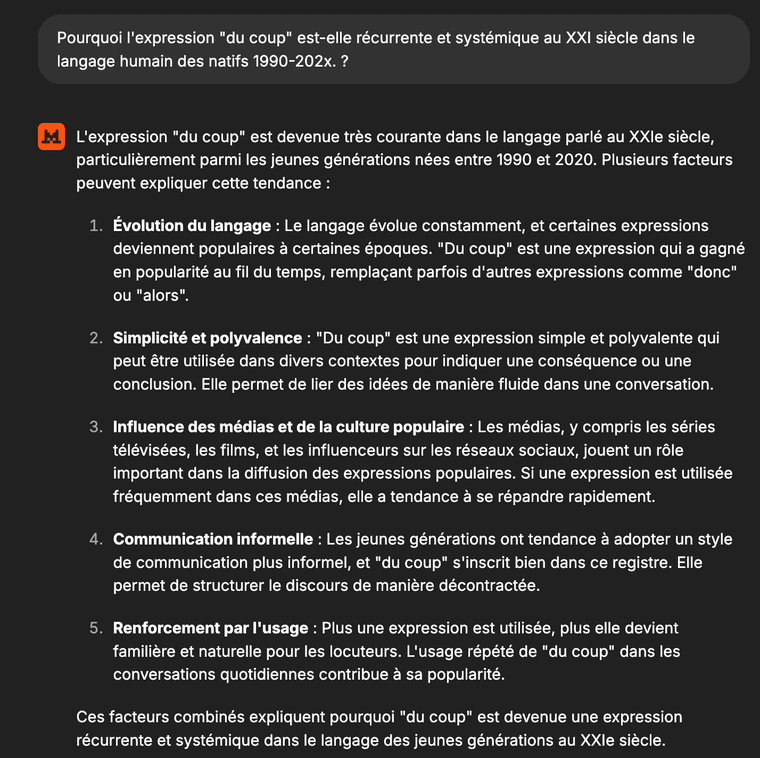

Ah ok ! Selon Chat Mistral IA au sujet de “du coup” :

- Influence des médias et de la culture populaire : Les médias, y compris les séries télévisées, les films, et les influenceurs sur les réseaux sociaux, jouent un rôle important dans la diffusion des expressions populaires. Si une expression est utilisée fréquemment dans ces médias, elle a tendance à se répandre rapidement.

Par imitation/effet miroir d’entraînement du coup ?

Comme les animaux sauvages dans la nature (i.e : le bébé chimpanzé qui imite par instinct de survie les gestes de sa mère) où le gugusse bas du front qui adopte les doctrines majoritaires propagées par les médias et les rézosociaux par influence avec délégation/abandon passive de son iibre arbitre du coup.

Comme les animaux sauvages dans la nature (i.e : le bébé chimpanzé qui imite par instinct de survie les gestes de sa mère) où le gugusse bas du front qui adopte les doctrines majoritaires propagées par les médias et les rézosociaux par influence avec délégation/abandon passive de son iibre arbitre du coup. -

@Aurel La même chose sur “résilience” ou autre macronisme ?

-

@Aurel

T’en fais pas que je peux parfaitement comprendre ce genre d’agacements. Même si rien à secouer de “du coup”, je serre les dents pour d’autres tics de langage que certains peuvent avoir. Du coup, je ne t’en tiens pas rigueur ^^Cela dit, cette chaîne YT est sympatoche même si elle s’essouffle un tantinet depuis quelques vidéos. Une petite tendance à surjouer/putaclicker.

Pour en revenir à cette histoire de serpent qui se mord la queue (d’IA qui se nourrit elle-même). Nous, humains, nous sommes nourris avec le savoir que nous avons pondu au fil du temps. Typiquement, on s’est expliqué que des gugusses marchent sur l’eau en donnant du pain tout en étant des enfants de divinités… Et pourtant, quelques fulgurances comme e=mc2 sont arrivées.

Peut-être que l’IA va se rendre compte nettement plus vite des bêtises que nous sortons et de celles qu’elle aura générée. -

@Popaul

Pour le moment, et tant que ce seront des humains intelligents et malgré cela qui géreront les datasets, tout ne sera pas perdu, après… -

@duJambon a dit dans Selon la BBC, Plus de la moitié des résumés de nouvelles écrits par LLM ont des «problèmes importants» :

tant que ce seront des humains intelligents et malgré cela qui géreront les datasets

Là, pas sûr, humains intelligents ? A la tête de tout ça je n’en vois pas.

Par contre complètement partiaux et dirigistes, là OUI !

Il est peut être déjà trop tard.Du coup, on est sur un sujet qui risque de partir en live (et là je me déteste).

Oui, l’expression c’est partir en vrille jusqu’à ce qu’une bande de décérébrés incultes refasse la culture des expression ancestrales. Merci M6 (et d’autres C8 et consorts) et ses rédacteurs stagiaires que personne ne contrôle.

-

@El-Bbz C’est vrai, mais la fille dans l’interview donnée en lien ci-dessus, a vraiment les pieds sur terre, et même si elle a un patron à qui elle doit obéir, je suis un peu tranquillisé de constater qu’elle a encore un bon sens des responsabilités, au lieu de voir un savant fou qui expérimente au hasard ou ne cherchant que la performance en termes d’économie.

C’est une vidéo que devraient voir tous ceux qui se gargarisent, ou même parlent, “d’intelligence” artificielle, ça remet exactement les choses à leur place.

-

@El-Bbz a dit dans Selon la BBC, Plus de la moitié des résumés de nouvelles écrits par LLM ont des «problèmes importants» :

rédacteurs stagiaires

On commence à voir des fautes de syntaxe et d’orthographe sur les bandeaux des chaînes info!

-

@Aurel Dommage pour toi, la vidéo était vraiment intéressante et la fille avait l’air de très bien maitriser son sujet. J’ai appris plein de trucs.

Quant à “du coup” tu devrais t’installer un switch (mental) qui te permette de profiter de choses intéressantes malgré des “du coup”.

Cela dit il m’est arrivé la même chose avec un podcast de “La conversation scientifique d’Etienne Klein” où le physicien italien tout à fait passionnant ponctuait toutes ses phrases d’un “no ?” comme font souvent les espagnols. LE sujet était passionnant alors j’ai tenu le coup, mais j’ai souffert Donc je comprends. -

Ouais, mais la récurrence des tics/expressions de langage et de gestuelles calibrés affaiblissent le sens du propos Je suis sensible à cette perception et je m’en détourne assez vite. C’est peut-être dommage, car je dois parfois louper des choses intéressantes entre le fond et la forme…

Maintenant, désolé d’avoir un brin “hors-sujetté” sur ce topic de @duJambon, qu’il me pardonne. Je boucle mon claque-merde et je vais m’efforcer de switcher mentalement. Mon méat coule pas.

-

Autant, je peux piger cette intolérance face à un présentateur dont c’est le “métier” (être beau dans tout les sens du terme).

Autant, tu pourrais faire un effort quand c’est une tite chercheuse chouquette. Raclure !!!

Perso, c’est les “alors” qui me font tiquer… pas ici mais, certains ont tendance à te sortir des “alors” à tire larigot quand ils expliquent leurs histoire.Sinon, cette chaîne YT vient de sortir une nouvelle vidéo ou ils montrent une interview du président français au sujet des IA… Pas vue mais, il est très fortement probable que c’est justement du généré.

-

@Popaul J’ai un pote qui finit une phrase sur deux par un “et tout machin”

-

@Aurel a dit dans Selon la BBC, Plus de la moitié des résumés de nouvelles écrits par LLM ont des «problèmes importants» :

Mon méat coule pas.

Sans vouloir me mêler de ce qui ne me regarde pas, il vaudrait quand même mieux qu’il coule de temps en temps, genre plusieurs fois par jour…

-

Des erreurs et une marche arrière: Apple désactive le nouvel outil d’IA pour résumer l’actualité

Apple a désactivé jeudi l’un de ses nouveaux outils d’intelligence artificielle (IA) générative, qui permet de recevoir des résumés sur l’actualité, après des erreurs et une plainte de la BBC en décembre.

Le géant américain des smartphones a commencé à déployer cet hiver son système d’IA générative, “Apple Intelligence”, deux ans après qu’OpenAI a lancé cette vague technologique avec ChatGPT, qui converse avec les utilisateurs et produit des contenus à la demande.

Depuis le succès de ChatGPT, Google, Microsoft, Meta et d’autres entreprises sont engagées dans une course rapide au déploiement de l’IA générative, avec des modèles toujours plus impressionnants, mais qui commettent aussi des erreurs. L’année dernière, une des versions du modèle de Google avait ainsi recommandé aux internautes d’utiliser de la colle dans les pizzas.

Source et plus: https://www.7sur7.be/tech/des-erreurs-et-une-marche-arriere-apple-desactive-le-nouvel-outil-dia-pour-resumer-lactualite~a90fd794/