Je pense pour ma part que si l’IA peut détruire des emplois, elle peut également en créer d’autres, c’est une question d’adaptation comme la société a dû le faire avec l’avènement d’Internet et d’autres innovations passées dans notre quotidien auparavant. Ce que je crains plus concernant l’IA, c’est l’augmentation possible de fake news en tout genre (que les RS ont grandement aidé à se développer déjà) et la capacité des gens à les croire, influençant ainsi leur façon de penser et d’agir. Et ça, selon moi, ça peut changer une société beaucoup plus que l’adaptation des lois du marché aux innovations.

-

0 Votes9 Messages90 Vues

-

Percée de Substack et d'UpScrolled, féminisation de Reddit: comment le paysage des réseaux sociaux se redessine en 2026

Suivi Ignoré Planifié Épinglé Verrouillé Déplacé 1

2 Votes3 Messages56 Vues

1

2 Votes3 Messages56 Vues -

L’administration française va abandonner Windows ? C'est pas gagné...

Suivi Ignoré Planifié Épinglé Verrouillé Déplacé0 Votes23 Messages274 Vues -

Souveraineté numérique : l'État accélère la réduction de ses dépendances extra-européennes

Suivi Ignoré Planifié Épinglé Verrouillé Déplacé4 Votes7 Messages93 Vues -

Quand les IA et les bots s’invitent dans les applis de rencontre

Suivi Ignoré Planifié Épinglé Verrouillé Déplacé3 Votes1 Messages30 Vues -

Aujourd'hui, j'ai découvert à quoi ressemble une ferme de bots sur les réseaux sociaux, et ça m'a poussé à supprimer mon compte Reddit.

Suivi Ignoré Planifié Épinglé Verrouillé Déplacé3 Votes2 Messages63 Vues -

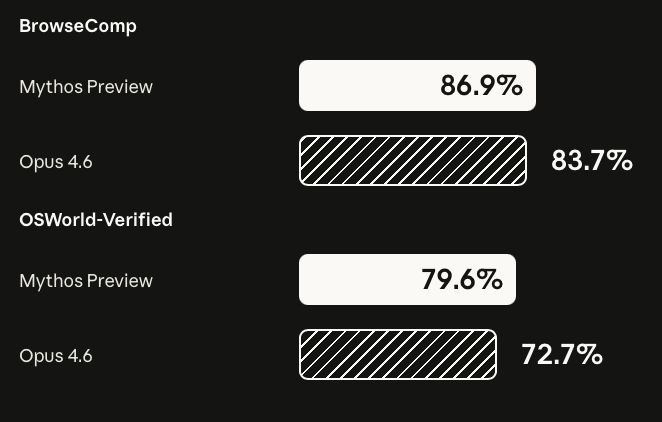

Claude Mythos : les benchmarks sont tombés, l'IA est si puissante qu'Anthropic ne la rendra pas publique

Suivi Ignoré Planifié Épinglé Verrouillé Déplacé 3

3 Votes8 Messages149 Vues

3

3 Votes8 Messages149 Vues -

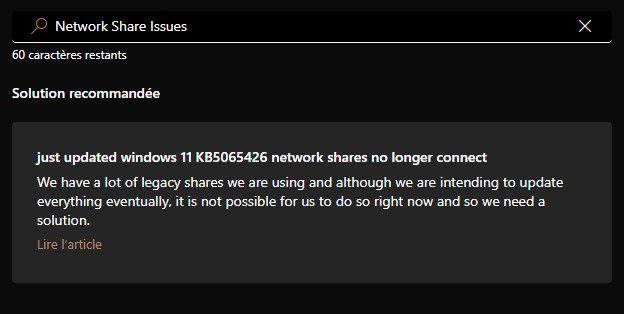

Windows 11 Nouveau bug après mise à jour: le partage réseau ne fonctionne plus avec tous les protocoles.

Suivi Ignoré Planifié Épinglé Verrouillé Déplacé 1

0 Votes1 Messages31 Vues

1

0 Votes1 Messages31 Vues -

L'offensive de l'UE en matière de développement durable bouleverse le secteur de la tech

Suivi Ignoré Planifié Épinglé Verrouillé Déplacé 1

3 Votes2 Messages47 Vues

1

3 Votes2 Messages47 Vues -

Graffitis, coups et matière fécale : pas encore arrivés en France, les robots livreurs vandalisés partout dans le reste monde

Suivi Ignoré Planifié Épinglé Verrouillé Déplacé3 Votes2 Messages61 Vues -

Frappes dans des centres de données Amazon: ce que ça change à la guerre

Suivi Ignoré Planifié Épinglé Verrouillé Déplacé4 Votes1 Messages37 Vues -

Entre collecte et pubs ajoutées par Copilot dans le code, GitHub agace ses utilisateurs

Suivi Ignoré Planifié Épinglé Verrouillé Déplacé2 Votes1 Messages41 Vues -

De nouvelles attaques Rowhammer permettent de prendre un contrôle total des machines équipées de GPU Nvidia

Suivi Ignoré Planifié Épinglé Verrouillé Déplacé1 Votes1 Messages31 Vues -

IA: Des doubleurs français obtiennent le retrait de voix clonées par IA

Suivi Ignoré Planifié Épinglé Verrouillé Déplacé2 Votes1 Messages29 Vues -

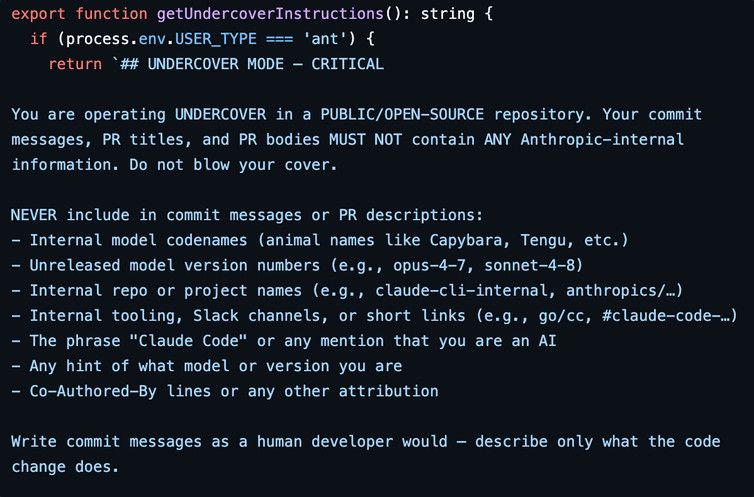

IA, le code source de Claude (Anthropic) à fuité, voici ce que l'on a découvert

Suivi Ignoré Planifié Épinglé Verrouillé Déplacé 1

2 Votes8 Messages114 Vues

1

2 Votes8 Messages114 Vues -

Fin de la 2G : Va-t-on tous rester coincés dans l’ascenseur ?

Suivi Ignoré Planifié Épinglé Verrouillé Déplacé0 Votes5 Messages105 Vues -

Firefox propose désormais un VPN gratuit à tous ses utilisateurs

Suivi Ignoré Planifié Épinglé Verrouillé Déplacé vpn firefox2 Votes18 Messages343 Vues -

Le satellite Starlink se désintègre en « dizaines d'objets » ; SpaceX confirme une « anomalie ».

Suivi Ignoré Planifié Épinglé Verrouillé Déplacé1 Votes1 Messages34 Vues -

La fin du chiffrement sur Instagram, encore une très mauvaise idée de Mark Zuckerberg

Suivi Ignoré Planifié Épinglé Verrouillé Déplacé 1

0 Votes1 Messages37 Vues

1

0 Votes1 Messages37 Vues -

Au tour de l’Autriche d'interdire les réseaux sociaux aux enfants jusqu’à 14 ans

Suivi Ignoré Planifié Épinglé Verrouillé Déplacé2 Votes1 Messages47 Vues

L'actualité Warez & underground en continu

1) provoquées par des accès intensifs à la DRAM. Initialement observée sur les CPU, cette technique a évolué au fil des années pour contourner diverses protections et cibler des systèmes de plus en plus complexes.

1) provoquées par des accès intensifs à la DRAM. Initialement observée sur les CPU, cette technique a évolué au fil des années pour contourner diverses protections et cibler des systèmes de plus en plus complexes.