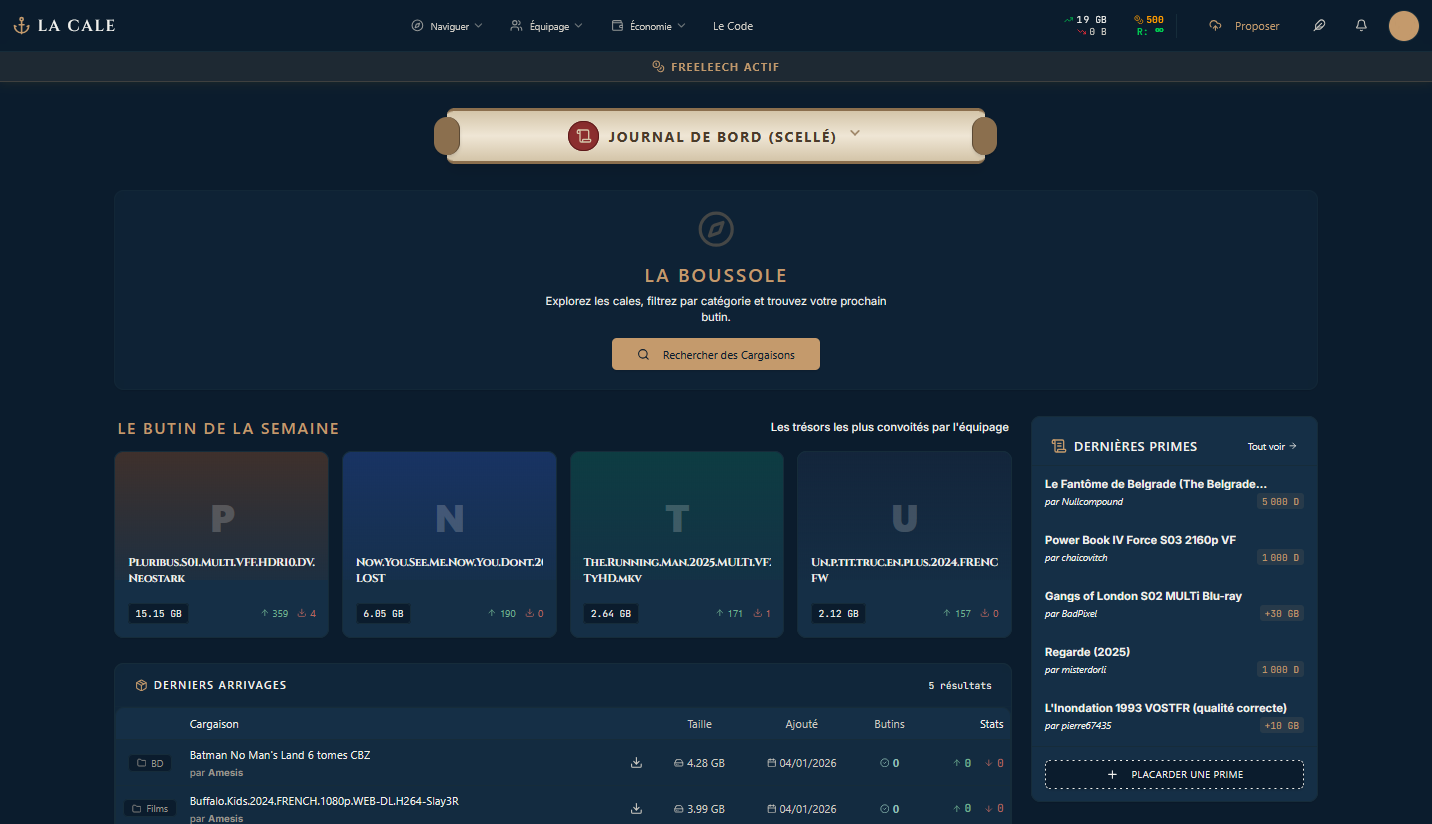

Ne confondez pas calewood et La Cale. Calewood est vibebodé et c’est totalement assumé.

Calewood n’a strictement rien à voir avec La Cale, ce ne sont pas les mêmes personnes.

La Cale ne l’est pas. Le développeur s’aide de l’IA au sein de son IDE, mais ce n’est pas du claude code ou des choses de cet acabit.

De ce que je sais, La Cale était en développement bien avant la mort de YGG, mais la sortie a été précipité “el famoso mode turbo”. En l’occurrence, il fonctionne bien et les principaux problèmes sont liés à la performance générale par rapport au nombres d’utilisateurs (et d’annonces surtout).

Ces problèmes auraient difficilement pu se voir durant la phase de test. Simuler 5 milliards d’annonces chaque jour en phase de développement, sur des machines de dev, puis extrapoler les mesures pour deviner la situation en prod, vous voyez le problème ?

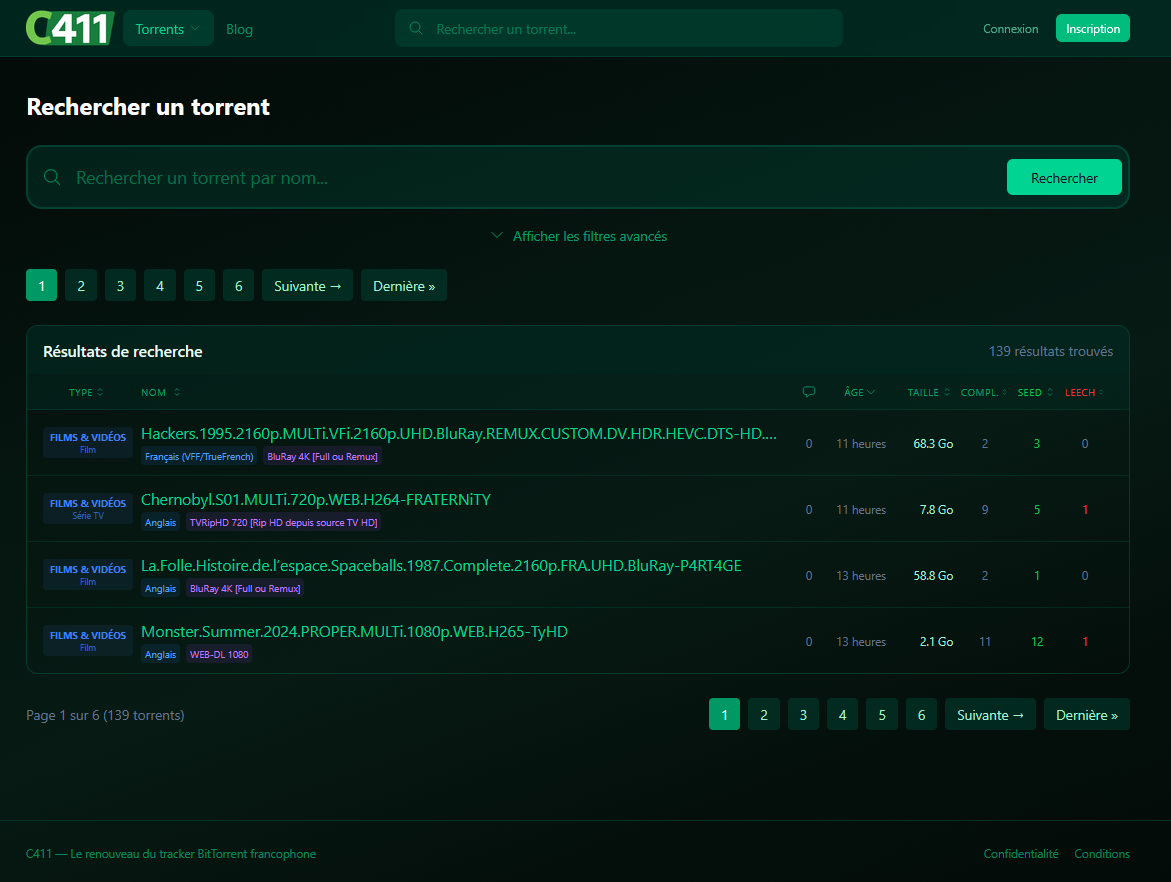

Fondamentalement, le principal problème qu’on peut entendre est lié au fait que c’est un VRAI développement et pas l’utilisation de plateformes telles que UNIT3D ou XBT, ou autre. C’est limitant à court terme, mais à mon avis, offre de belles possibilités d’évolutions par la suite là ou un UNIT3D finira pas poser problème (je crois savoir que torr9 montre des signes de fatigue en ce moment ?)

Je suis fatigué d’entendre ces reproches “han c’est vibecodé, c’est tout pas beau” : Non ça ne l’est pas, et même s’il ça l’était, il faut vivre avec son temps. Entre un dev et Madame Michu de la compta qui vibecodent, le résultat ne sera PAS DU TOUT le même.

Par pitié, faites preuve de patience et de compréhension. Voyez l’investissement de chacun, du staff, de la TP, des uploadeurs et même de la bonne humeur des membres. Faites preuve de discernement dans vos propos. Et puis, n’oublions jamais qu’il n’existe pas que La Cale et qu’il est toujours bien d’être sur plusieurs trackers en même temps.

PS : Ce post serait presque mieux sur reddit qu’ici, la communauté PW semble être vraiment bien

2

2