[image: 1775731322502-59a75018-559c-43e8-a908-ee7b8bb7d48f-image-resized.jpeg]

J’adore Nextcloud, ça fait plein de choses et quand on doit gérer une équipe c’est vraiment pratique. Mais franchement des fois je ne comprends pas que ça soit aussi lourd et lent. Ils devraient s’inspirer de la philosophie d’Opencloud

La promesse : légèreté et rapidité avant tout

Opencloud se positionne comme une alternative minimaliste et rapide aux solutions de stockage cloud auto-hébergées. Contrairement à Nextcloud qui propose une suite complète d’outils (emails, tâches, contacts, notes), Opencloud se concentre sur l’essentiel : la gestion de fichiers.

Et sur ce point précis, la différence est bluffante.

Une navigation instantanée

La première impression est saisissante : aucun temps de chargement perceptible. La navigation entre les dossiers est instantanée, les menus s’affichent sans délai, et l’ouverture des fichiers est quasi immédiate.

Pour comprendre l’écart de performance, la comparaison avec Nextcloud (même optimisé) est édifiante :

- Sur Nextcloud : chaque clic entraîne un temps de chargement visible

- Sur Opencloud : l’interface réagit comme une application native

Cette fluidité s’explique par une architecture technique différente : Opencloud gère l’organisation des dossiers via des métadonnées, sans base de données. C’est la même philosophie que les sites statiques, qui privilégient la rapidité au détriment de certaines fonctionnalités avancées.

Gestion des fichiers : une expérience desktop

Copier-coller natif

Opencloud brille par sa gestion intuitive des fichiers, qui rappelle l’expérience d’un explorateur de fichiers classique :

- Sélection multiple avec Shift + clic

- Copier-coller avec Ctrl+C / Ctrl+V ou clic droit

- Couper-coller pour déplacer des fichiers

- Drag & drop ultra-réactif

Les opérations de glisser-déposer fonctionnent sans friction, même avec des fichiers volumineux (700 Mo dans le test). Pas besoin de viser une zone spécifique : vous déposez le fichier n’importe où dans l’interface et il se charge immédiatement.

Comparaison avec Nextcloud

Sur Nextcloud, ces mêmes opérations sont plus lourdes :

- Le clic droit natif du navigateur n’offre pas de fonctionnalités avancées

- Pour copier ou déplacer un fichier, il faut passer par un menu qui ouvre une fenêtre de sélection

- Le drag & drop nécessite de viser précisément la zone de dépôt

- Chaque action s’accompagne d’un temps de chargement

Recherche plain-texte native

Une fonctionnalité particulièrement appréciable : la recherche dans le contenu des fichiers est activée par défaut.

Comment ça fonctionne

Créez un fichier Markdown, ajoutez-y du contenu, et lancez une recherche sur un mot présent dans le document : Opencloud retrouve immédiatement le fichier concerné. La recherche ne se limite pas aux noms de fichiers, elle indexe le contenu textuel.

L’écart avec Nextcloud

Sur Nextcloud, cette fonctionnalité existe mais n’est pas activée par défaut :

- Elle nécessite une configuration manuelle

- L’activation consomme davantage de RAM

- Sans cette configuration, la recherche se limite aux noms de fichiers

Édition collaborative avec Collabora

Opencloud intègre Collabora Online (basé sur LibreOffice), permettant l’édition collaborative de documents bureautiques.

Fonctionnalités testées

- Création de documents texte, tableurs, présentations

- Édition en temps réel avec plusieurs utilisateurs

- Prévisualisation Markdown (code à gauche, rendu à droite)

- Partage via lien public avec mot de passe optionnel

- Permissions granulaires (lecture seule ou modification)

Édition collaborative en pratique

Le test montre deux utilisateurs travaillant simultanément sur le même document :

- Indication visuelle des utilisateurs connectés

- Synchronisation fluide des modifications

- Possibilité de “prendre la main” pour éditer

Cette fonctionnalité n’est pas exclusive à Opencloud (Nextcloud propose également Collabora), mais son intégration est fluide et l’expérience reste rapide.

Espaces partagés : gestion centralisée

Opencloud permet de créer des espaces partagés qui n’appartiennent pas à un utilisateur spécifique mais à l’organisation. C’est l’équivalent des drives partagés sur d’autres plateformes cloud.

Configuration des espaces

- Création d’espaces thématiques (Marketing, RH, etc.)

- Attribution de membres avec permissions

- Définition de quotas de stockage par espace

- Personnalisation de l’image de l’espace

Cette approche permet d’éviter qu’un seul utilisateur monopolise l’espace de stockage et facilite la gestion collaborative.

Synchronisation desktop

Un client de synchronisation est disponible pour Mac (et probablement Windows/Linux), offrant une synchronisation bidirectionnelle entre le cloud et le système local.

Fonctionnalités de synchronisation

- Synchronisation sélective des espaces

- Choix des dossiers à synchroniser

- Gestion des espaces partagés et personnels

- Synchronisation en temps réel

L’application se présente sous forme de plugin système, permettant de choisir précisément quels espaces synchroniser localement.

Quelques limitations

Le projet étant relativement récent, quelques effets de bord subsistent dans l’expérience de synchronisation. Rien de bloquant, mais l’outil continue d’évoluer.

Stockage objet S3

Opencloud supporte nativement le stockage S3-compatible, permettant une architecture optimisée en termes de coûts :

- Serveur VPS pour l’application

- Stockage des fichiers sur un bucket S3 externe

Avantages de cette approche

Le stockage objet coûte généralement moins cher que le stockage sur VPS. Cette séparation permet de dimensionner le serveur applicatif en fonction des besoins de calcul, tout en externalisant le stockage sur une infrastructure dédiée (AWS S3, Scaleway, OVH Object Storage, etc.).

Compatibilité CalDAV/CardDAV

Bien qu’Opencloud ne propose pas nativement de gestion de calendriers et contacts, il est compatible avec Radicale, un serveur CalDAV/CardDAV dédié.

Fonctionnement

- Installation de Radicale en parallèle d’Opencloud

- Utilisation des identifiants Opencloud pour l’authentification

- Génération d’URLs CalDAV pour synchronisation avec clients externes

- Gestion centralisée des utilisateurs

Cette approche modulaire permet de compléter les fonctionnalités d’Opencloud sans alourdir le système principal.

Magasin d’applications

Un store d’applications commence à émerger, bien que beaucoup plus limité que celui de Nextcloud.

Applications disponibles

- Positionnement de photos sur carte

- Draw.io pour les diagrammes

- Quelques extensions supplémentaires en cours de développement

Le catalogue reste modeste, mais c’est cohérent avec la philosophie du projet : rester léger et focalisé sur l’essentiel.

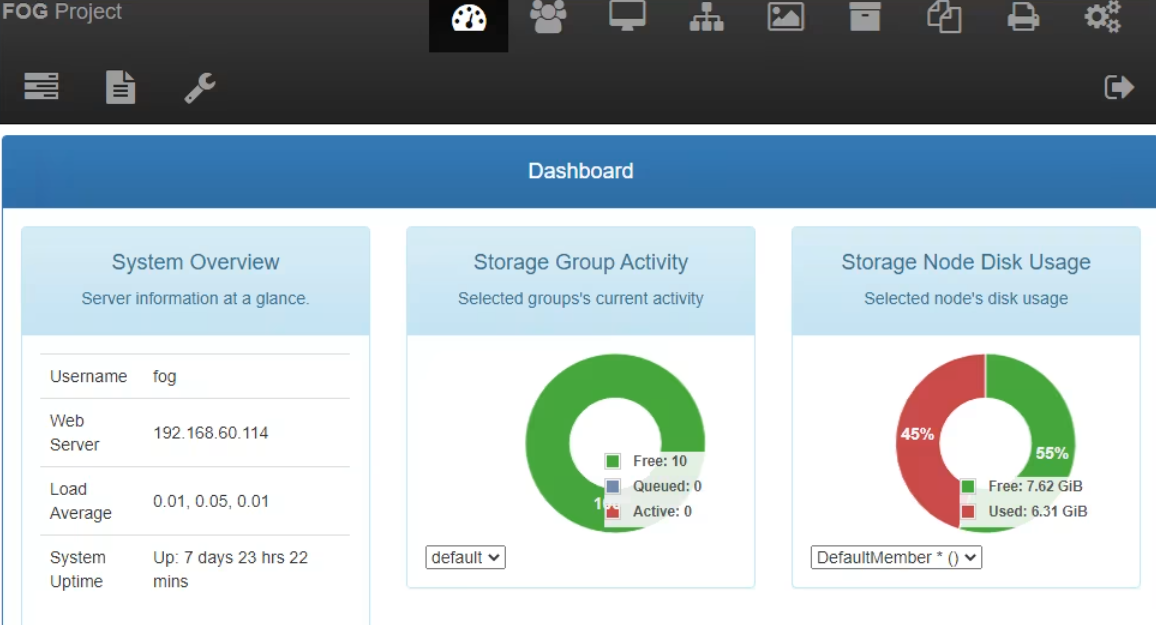

Installation et déploiement

Opencloud propose plusieurs méthodes d’installation :

Docker Compose (recommandé)

La méthode officiellement supportée, offrant la meilleure expérience de déploiement et de maintenance.

Docker standard

Version conteneurisée classique pour ceux qui préfèrent une approche Docker traditionnelle.

Bare metal

Installation directe sur le système, possible mais non recommandée officiellement. Contrairement à certains projets où le bare metal est privilégié, Opencloud favorise clairement Docker.

Temps d’installation

L’installation est décrite comme rapide : 10 minutes suffisent pour avoir une instance fonctionnelle, sans configuration complexe de cache, de limites PHP ou de génération d’aperçus (contrairement à Nextcloud qui nécessite ces optimisations).

Contexte du projet : un fork d’ownCloud Infinite Scale

Origines

Opencloud n’est pas un projet parti de zéro. Il s’agit d’un fork d’ownCloud Infinite Scale, créé par d’anciens membres de cette équipe qui ont quitté le projet pour des raisons diverses (discutées sur Reddit pour ceux qui veulent creuser).

Implications

- Base de code éprouvée

- Architecture déjà mature sur certains aspects

- Communauté en construction

- Évolution rapide du projet

Le projet est donc relativement récent en tant qu’entité indépendante, mais il ne part pas de rien techniquement.

Best-of-breed vs tout-en-un : quelle approche choisir ?

L’approche Nextcloud (tout-en-un)

- Avantages : interface unifiée, un seul outil à gérer, écosystème riche

- Inconvénients : lourdeur, temps de chargement, complexité croissante

L’approche Opencloud (best-of-breed)

- Avantages : légèreté, rapidité, chaque outil excellent dans son domaine

- Inconvénients : multiplication des outils, gestion de plusieurs services

La philosophie d’Opencloud consiste à se concentrer sur la gestion de fichiers et à laisser d’autres outils spécialisés (comme Radicale pour les calendriers) gérer les autres besoins.

Alternative à explorer : CopyParty

Dans le même esprit de légèreté, CopyParty représente une autre alternative ultra-rapide pour la gestion de fichiers, avec une approche encore plus minimaliste qu’Opencloud.

Pour qui est fait Opencloud ?

Cas d’usage idéaux

- Besoin prioritaire de gestion de fichiers rapide et fluide

- Équipes nécessitant des espaces partagés avec quotas

- Utilisateurs frustrés par la lourdeur de Nextcloud

- Infrastructures où la rapidité prime sur l’exhaustivité fonctionnelle

Quand préférer Nextcloud

- Besoin d’une suite complète (emails, tâches, notes, etc.)

- Préférence pour un écosystème tout-en-un

- Dépendance à des applications spécifiques du store Nextcloud

- Besoin de fonctionnalités avancées de groupware

Verdict

Opencloud ne remplace pas Nextcloud sur tous les aspects, mais il excelle dans son domaine de prédilection : la gestion de fichiers rapide et efficace. Si vous cherchez avant tout un outil de partage et de synchronisation de fichiers qui ne vous fasse pas sentir que vous naviguez sur un paquebot, Opencloud mérite clairement votre attention.

La rapidité d’installation, l’absence de configuration complexe, et surtout la fluidité d’utilisation au quotidien en font une option très séduisante pour qui privilégie la simplicité et la performance à l’exhaustivité fonctionnelle.

Points forts

- Rapidité et fluidité exceptionnelles

- Gestion de fichiers intuitive (copier-coller, drag & drop)

- Recherche plain-texte native

- Installation simple et rapide

- Support S3 natif

- Espaces partagés avec quotas

Points d’attention

- Fonctionnalités limitées à la gestion de fichiers

- Magasin d’applications encore restreint

- Projet relativement récent

- Nécessite des outils complémentaires pour certains usages (calendrier, contacts)

– Sources :

https://opencloud.eu/en

https://docs.opencloud.eu/docs/admin/getting-started/

https://www.stackgui.de/lab/opencloud-alternative-ultra-rapide-a-nextcloud/

–> Perso, je n’ai pas testé, je partage. Je sais juste que c’est un Fork d’ownCloud, créé par les devs originaux après leur départ et que si Nextcloud te gonfle avec sa lourdeur PHP et ses 47 tables MySQL (merci Korben), ça peut être une bonne solution alternative.

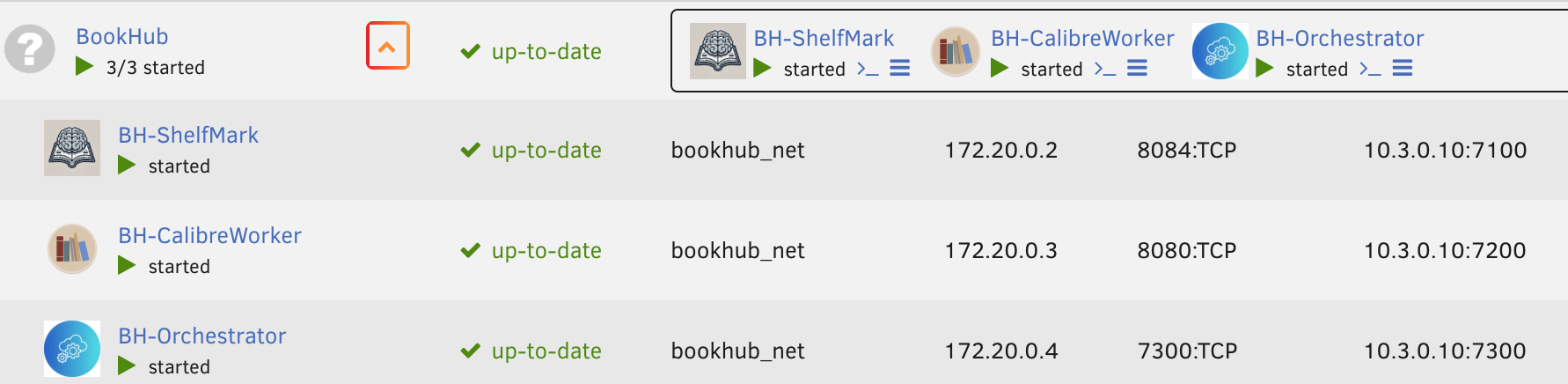

BookHub — Automatisation complète de ma bibliothèque d’ebooks

BookHub — Automatisation complète de ma bibliothèque d’ebooks