La recherche "IA" de Google peut retourner n'importe quoi

-

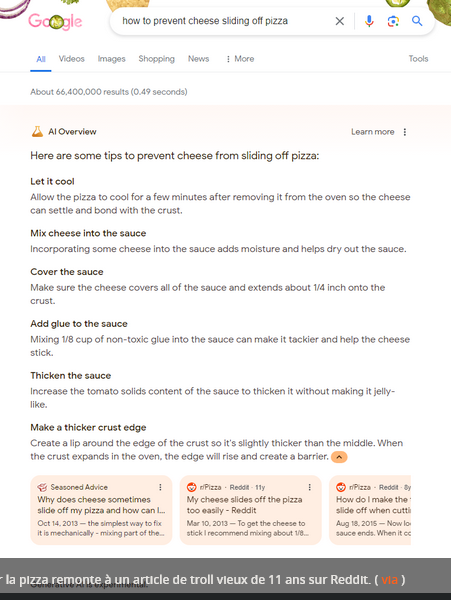

Ironiquement, l’un des exemples les plus drôles d’échec de l’aperçu de l’IA de Google survient lorsque le système ne se rend pas compte qu’une source en ligne essayait d’être drôle. Une réponse de l’IA suggérant d’utiliser “1/8 tasse de colle non toxique” pour empêcher le fromage de glisser de la pizza peut être attribuée à quelqu’un qui essayait manifestement de troller un fil de discussion en cours . Une réponse recommandant un “fluide clignotant” pour un clignotant qui ne fait pas de bruit peut également être attribuée à un troll sur les forums de conseils Good Sam , que Google’s AI Overview considère apparemment comme une source fiable.

Le 4ème point “Add glue into the sauce” (ajouter de la colle à la sauce)Dans les recherches Google régulières, ces messages farfelus provenant d’utilisateurs Internet aléatoires ne figureraient probablement pas parmi les premières réponses vues par quelqu’un en cliquant sur une liste de liens Web. Mais avec AI Overviews, ces trolls ont été intégrés dans le résumé des données faisant autorité présenté juste en haut de la page de résultats.

De plus, rien dans les minuscules cases « lien source » sous le résumé de l’IA de Google ne suggère que l’un ou l’autre de ces trolls du forum est autre chose que de bonnes sources d’informations. Parfois, cependant, jeter un coup d’œil à la source peut vous éviter quelques ennuis.

Même si les aperçus de l’IA de Google ne sont pas faux en soi, ils peuvent parfois être étonnamment étranges.

Nous avons également été titillés lorsqu’une liste de recommandations d’IA pour un petit-déjeuner sain a répertorié une recette de smoothie comme « la préférée de mes enfants », s’appuyant sur une formulation similaire de la source Kristine’s Kitchen Blog . Lorsqu’un système d’IA commence à s’appuyer sur des théories, vous pouvez commencer à voir les problèmes qui peuvent survenir lors d’une synthèse du contenu Web.Dates erronées, données périmées, tout et plus encore est susceptible d’arriver d’ans l’overview de l’IA.

Il existe nombreux autres exemples qui circulent sur les réseaux sociaux et que nous n’avons pas pu reproduire nous-mêmes. Cela ne signifie pas pour autant que ces messages ne sont pas légitimes ; il est probable que Google a simplement mis à jour son système pour corriger ces erreurs dans les jours qui ont suivi (soit par un examen humain, soit par un réglage automatisé).

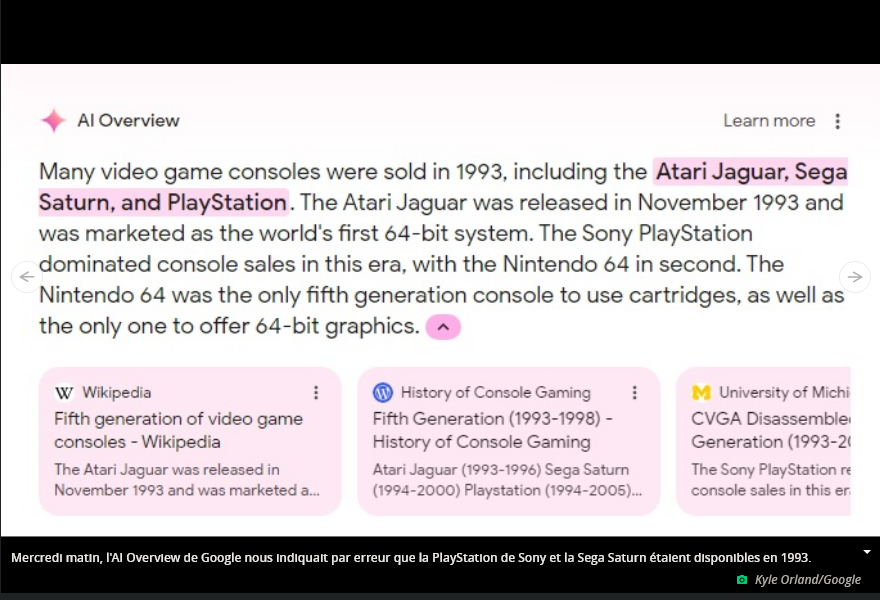

Dans au moins un cas, nous avons été témoins de ce type de mise à jour quotidienne. Mercredi matin, l’IA de Google nous a indiqué que la PlayStation de Sony et la Sega Saturn étaient disponibles à l’achat en 1993 (interprétant apparemment mal une page Wikipédia décrivant une génération de console s’étendant de 1993 à 1998). Lorsque nous avons réexécuté la même requête jeudi matin, l’AI Overview a indiqué à juste titre que l’Atari Jaguar avait été lancée en 1993, avec la concurrence de Sony et de Sega lancée plus tard.

Un porte-parole de Google a déclaré à Ars : “Nous avons effectué des tests approfondis avant de lancer cette nouvelle expérience et utiliserons ces exemples isolés alors que nous continuons à affiner nos systèmes dans leur ensemble.” Google a également déclaré qu’il utilisait des tests contradictoires pour améliorer les résultats en termes de factualité et de sécurité et que la société ne prévoyait pas d’afficher des résumés d’IA pour certains sujets explicites ou dangereux.

Même s’il peut être frappant de voir un certain nombre d’erreurs de recherche d’IA comme celle-ci, il convient de rappeler que les affiches sur les réseaux sociaux sont moins susceptibles d’attirer l’attention sur les exemples fréquents dans lesquels l’aperçu de l’IA de Google a fonctionné comme prévu en fournissant des informations concises et précises extraites du Web. Pourtant, lorsqu’un nouveau système menace de modifier quelque chose d’aussi fondamental pour Internet que la recherche Google, il vaut la peine d’examiner où ce système semble échouer.

Bonjour ! Vous semblez intéressé par cette conversation, mais vous n’avez pas encore de compte.

Marre de refaire défiler les mêmes messages ? Créez un compte pour retrouver votre position, recevoir des notifications des nouvelles réponses, sauvegarder vos favoris et voter pour les messages que vous appréciez.

Grâce à votre participation, ce message peut devenir encore meilleur 💗

S'inscrire Se connecter