[image: 1744447917079-5638c5e1-07a4-48ed-a981-7656809f1579-image-resized.png]

Les pleurotes et les chutes de meubles en bambou recyclées peuvent être une combinaison improbable pour un matériau de construction résistant, mais les ingénieurs ont utilisé ce curieux mélange pour créer une nouvelle tuile inspirée du biomimétisme, présentant des bosses et des crevasses comme la peau d’éléphant, conçue pour garder les murs au frais et résister aux éléments.

Des scientifiques dirigés par l’Université technologique de Nanyang, à Singapour (NTU Singapore), ont créé ce qu’ils appellent des « tuiles fongiques », conçues pour refroidir passivement les bâtiments et résister aux forces environnementales comme les fortes pluies dans les climats tropicaux.

« Les matériaux isolants sont de plus en plus intégrés aux murs des bâtiments pour améliorer l’efficacité énergétique. Cependant, ils sont principalement synthétiques et ont des conséquences environnementales tout au long de leur cycle de vie », explique Hortense Le Ferrand, professeure associée aux facultés de génie mécanique et aérospatial (MAE) et de science et génie des matériaux (MSE) de la NTU. « Le composite lié au mycélium est un matériau biodégradable et hautement poreux, ce qui en fait un bon isolant. De fait, sa conductivité thermique est comparable, voire supérieure, à celle de certains matériaux isolants synthétiques utilisés dans les bâtiments actuels. »

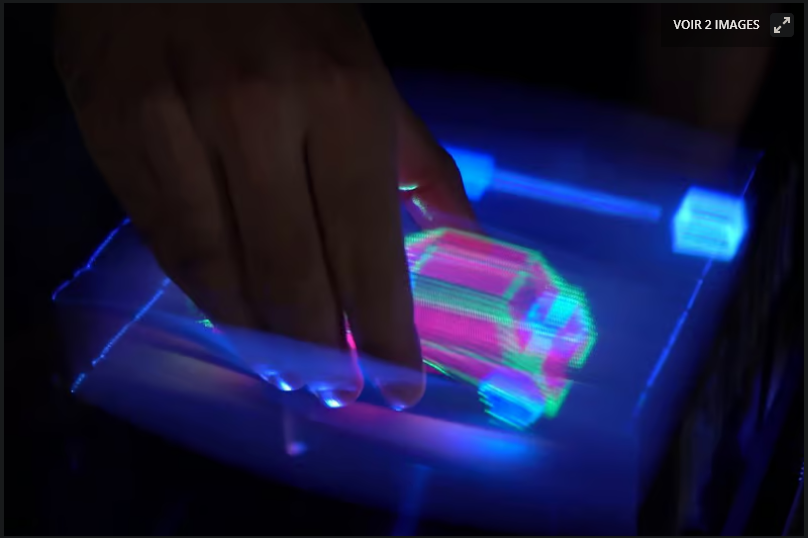

Le mycélium est de plus en plus utilisé pour former la base de nouveaux matériaux biotechnologiques – de l’ insonorisation au ciment , et il est même développé comme outil pour éponger les marées noires et isoler les maisons contre les incendies . Ici, les chercheurs ont combiné le mycélium du pleurote commun ( Pleurotus ostreatus ) avec des copeaux de bambou récupérés dans un magasin de meubles. Les matériaux de base ont ensuite été mélangés à de l’avoine et de l’eau, puis pressés dans des moules présentant des empreintes en forme de bulles et des lignes rugueuses. Les carreaux ont ensuite été laissés à « pousser » dans l’obscurité pendant quatre semaines – deux dans le moule et deux après leur démoulage – avant d’être séchés pendant trois jours dans un four chaud.

Fruit d’une collaboration entre l’équipe de la NTU et bioSEA, une entreprise singapourienne spécialisée dans l’écologie et le biomimétisme, le moule a été conçu non seulement pour présenter des bosses ondulantes, mais aussi un motif texturé rappelant la peau d’éléphant. Ces grands animaux possèdent un système de refroidissement spécifique : boue, poils fins et clairsemés, rides et crevasses qui contribuent à retenir l’humidité, à dissiper la chaleur et à réguler la température.

[image: 1744448037738-9b2ca23f-77c2-450e-b0a8-0ca61f175a72-image.png]

Le mélange bambou-mycélium, tel qu’il est emballé dans le moule, ressemble à de la soie de porc

« Les éléphants sont de grands animaux qui vivent dans des climats tropicaux chauds et parfois humides », explique Anuj Jain, directeur fondateur de bioSEA. « Pour résister à la chaleur, les éléphants ont évolué pour développer une peau fortement ridée, ce qui augmente la rétention d’eau et rafraîchit l’animal par évaporation. Nous nous sommes inspirés de la capacité d’un éléphant à se rafraîchir par temps chaud sans glandes sudoripares, et avons cherché à reproduire les mêmes mécanismes de refroidissement : protection solaire, rétention d’air frais et augmentation de la surface d’évaporation de l’eau. »

Les scientifiques ont placé les tuiles sur une plaque chauffante à 100 °C (212 °F) pendant 15 minutes et ont suivi les variations de température à l’aide d’une caméra infrarouge. La conception en peau d’éléphant a absorbé la chaleur plus lentement, gardant la face inférieure plane plus fraîche, et cette face plane a également refroidi plus rapidement. Lors d’essais de simulation de pluie, les gouttes d’eau ont été retenues dans les fissures de la tuile, mais n’ont pas été absorbées par le matériau, ce qui a permis un refroidissement encore plus efficace.

« La pellicule fongique qui se développe à la surface du carrelage repousse l’eau, permettant aux gouttelettes de rester à la surface plutôt que de rouler immédiatement », explique Eugene Soh, cinquième auteur de l’étude et chercheur à la NTU. « Cela favorise le refroidissement par évaporation, augmentant ainsi la vitesse de refroidissement. »

Les scientifiques travaillent actuellement à tester la durabilité de la tuile et à déterminer si différentes espèces de champignons pourraient améliorer la structure et la fonction du matériau. Bien que évolutif, peu coûteux et durable – l’équipe collabore avec une start-up locale, Mykílio, pour augmenter la production et réaliser des tests en extérieur – ce matériau présente certaines limites. Notamment, le temps de croissance du mycélium : un mois de production d’une tuile nécessiterait un espace de culture conséquent pour être commercialement viable.

« Nous avons développé une alternative écologique prometteuse qui transforme les déchets en une ressource précieuse tout en repensant les matériaux de gestion thermique conventionnels », a déclaré Le Ferrend. « Cela ouvre la voie à davantage de designs inspirés de la peau d’éléphant et à l’utilisation de différentes souches de mycélium pour surmonter les défis liés à l’utilisation de tuiles de mycélium comme matériau de construction alternatif. »

Source: https://newatlas.com/materials/elephant-skin-mycelium-tiles/

La recherche a été publiée dans la revue: Energy and Buildings

Et: Université technologique de Nanyang, Singapour